WASHINGTON – Nu honderden miljoenen mensen zich voor advies tot chatbots wenden, was het slechts een kwestie van tijd voordat technologiebedrijven programma’s gingen aanbieden die specifiek waren ontworpen om gezondheidsvragen te beantwoorden.

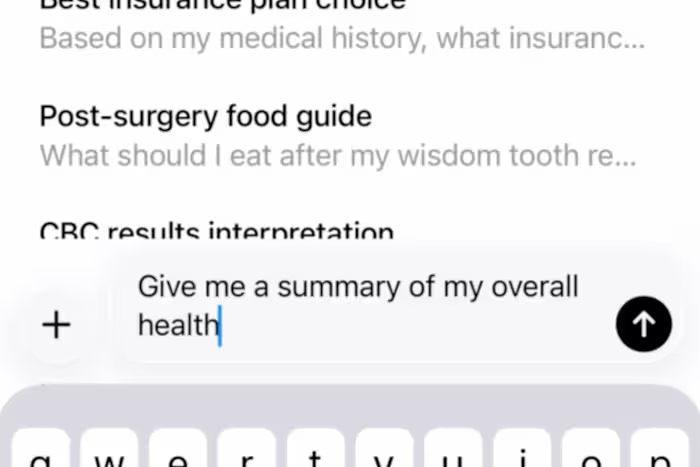

In januari introduceerde OpenAI ChatGPT Health, een nieuwe versie van zijn chatbot die volgens het bedrijf de medische dossiers van gebruikers, welzijnsapps en draagbare apparaatgegevens kan analyseren om gezondheids- en medische vragen te beantwoorden. Momenteel is er een wachtlijst voor het programma. Anthropic, een rivaliserend AI-bedrijf, biedt vergelijkbare functies voor sommige gebruikers van zijn Claude-chatbot.

Aanbevolen video’s

Beide bedrijven zeggen dat hun programma’s, bekend als grote taalmodellen, geen vervanging zijn voor professionele zorg en niet mogen worden gebruikt om medische aandoeningen te diagnosticeren. In plaats daarvan zeggen ze dat de chatbots ingewikkelde testresultaten kunnen samenvatten en uitleggen, kunnen helpen bij de voorbereiding op een doktersbezoek of belangrijke gezondheidstrends kunnen analyseren die verborgen liggen in medische dossiers en app-statistieken.

Hier zijn enkele dingen waarmee u rekening moet houden voordat u met een chatbot over uw gezondheid praat:

Chatbots kunnen meer gepersonaliseerde informatie bieden dan een Google-zoekopdracht

Sommige artsen en onderzoekers die met ChatGPT Health en soortgelijke programma’s hebben gewerkt, zien dit als een verbetering ten opzichte van de status quo.

AI-platforms zijn niet perfect – ze kunnen soms hallucineren of slecht advies geven – maar de informatie die ze produceren is waarschijnlijker gepersonaliseerd en specifiek dan wat patiënten zouden kunnen vinden via een Google-zoekopdracht.

“Het alternatief is vaak niets, of de patiënt die ermee aan de slag gaat”, zegt dr. Robert Wachter, expert op het gebied van medische technologie aan de Universiteit van Californië, San Francisco. “En dus denk ik dat als je deze tools op een verantwoorde manier gebruikt, je nuttige informatie kunt krijgen.”

Een voordeel van de nieuwste chatbots is dat ze de vragen van gebruikers beantwoorden met context uit hun medische geschiedenis, inclusief recepten, leeftijd en doktersaantekeningen.

Zelfs als u AI geen toegang tot uw medische informatie heeft gegeven, raden Wachter en anderen aan om de chatbots zoveel mogelijk details te geven om de reacties te verbeteren.

Als u zorgwekkende symptomen heeft, sla dan AI over

Wachter en anderen benadrukken dat er situaties zijn waarin mensen de chatbot moeten overslaan en onmiddellijk medische hulp moeten zoeken. Symptomen zoals kortademigheid, pijn op de borst of ernstige hoofdpijn kunnen wijzen op een medisch noodgeval.

Zelfs tijdens minder urgente situaties moeten patiënten en artsen AI-programma’s met “een zekere mate van gezond scepticisme” benaderen, aldus dr. Lloyd Minor van Stanford University.

“Als je het hebt over een belangrijke medische beslissing, of zelfs over een kleinere beslissing over je gezondheid, moet je nooit alleen maar vertrouwen op wat je uit een groot taalmodel haalt”, zegt Minor, decaan van de medische school van Stanford.

Denk aan uw privacy voordat u gezondheidsgegevens uploadt

Veel voordelen die AI-bots bieden, komen voort uit het delen van persoonlijke medische informatie door gebruikers. Maar het is belangrijk om te begrijpen dat alles wat met een AI-bedrijf wordt gedeeld, niet wordt beschermd door de federale privacywet die normaal gesproken van toepassing is op gevoelige medische informatie.

De wet, algemeen bekend als HIPAA, staat boetes en zelfs gevangenisstraffen toe voor artsen, ziekenhuizen, verzekeraars of andere gezondheidsdiensten die medische dossiers openbaar maken. Maar de wet geldt niet voor bedrijven die chatbots ontwerpen.

“Als iemand zijn medische kaart uploadt naar een groot taalmodel, is dat heel anders dan deze aan een nieuwe arts overhandigen”, zegt Minor. “Consumenten moeten begrijpen dat er totaal verschillende privacynormen gelden.”

Zowel OpenAI als Anthropic zeggen dat de gezondheidsinformatie van gebruikers gescheiden wordt gehouden van andere soorten gegevens en onderworpen is aan aanvullende privacybescherming. De bedrijven gebruiken geen gezondheidsgegevens om hun modellen te trainen. Gebruikers moeten zich aanmelden om hun informatie te delen en kunnen de verbinding op elk gewenst moment verbreken.

Uit tests blijkt dat chatbots kunnen struikelen

Ondanks de opwinding rond AI staat het onafhankelijk testen van de technologie nog in de kinderschoenen. Vroege studies suggereren dat programma’s als ChatGPT medische onderzoeken op hoog niveau kunnen doorstaan, maar vaak struikelen bij interactie met mensen.

Uit een onderzoek onder 1.300 deelnemers van de Universiteit van Oxford is onlangs gebleken dat mensen die AI-chatbots gebruiken om hypothetische gezondheidsproblemen te onderzoeken, geen betere beslissingen namen dan mensen die online zoekopdrachten of persoonlijk oordeel gebruikten.

AI-chatbots die medische scenario’s in een alomvattende, schriftelijke vorm presenteerden, identificeerden de onderliggende aandoening in 95% van de gevallen correct.

“Dat was niet het probleem”, zegt hoofdauteur Adam Mahdi van het Oxford Internet Institute. “De plek waar dingen uit elkaar vielen was tijdens de interactie met de echte deelnemers.”

Mahdi en zijn team ontdekten verschillende communicatieproblemen. Mensen gaven de chatbots vaak niet de nodige informatie om het gezondheidsprobleem correct te identificeren. Omgekeerd reageerden de AI-systemen vaak met een combinatie van goede en slechte informatie, en gebruikers hadden moeite om onderscheid te maken tussen de twee.

Het onderzoek, uitgevoerd in 2024, maakte geen gebruik van de nieuwste chatbotversies, inclusief nieuwe aanbiedingen zoals ChatGPT Health.

Een tweede AI-advies kan nuttig zijn

De mogelijkheid voor chatbots om vervolgvragen te stellen en belangrijke details van gebruikers te ontlokken is een gebied waarop Wachter ruimte voor verbetering ziet.

“Ik denk dat dit het moment is waarop dit echt goed zal worden, wanneer de hulpmiddelen een beetje dokterachtiger worden in de manier waarop ze heen en weer gaan” met patiënten, zei Wachter.

Eén manier om je zekerder te voelen over de informatie die je nu krijgt, is door meerdere chatbots te raadplegen, vergelijkbaar met het verkrijgen van een second opinion bij een andere arts.

“Ik zal soms informatie in ChatGPT en informatie in Gemini plaatsen”, zei Wachter, verwijzend naar de AI-tool van Google. “En als ze het er allebei over eens zijn, voel ik me een beetje zekerder dat dat het juiste antwoord is.”